Huawei готовит инфраструктурное программное решение, способное почти вдвое повысить эффективность использования ИИ-ускорителей. Платформа обеспечит унифицированное управление GPU и NPU различных производителей и позволит увеличить загрузку вычислительных ресурсов до 70% против текущих 30–40%. Для операторов ЦОД и корпоративных заказчиков это означает рост производительности без расширения аппаратного парка.

Что меняется для AI-инфраструктуры

Сегодня большинство ИИ-кластеров работают с неполной загрузкой из-за:

- фрагментации ресурсов,

- неравномерного распределения задач,

- сложностей оркестрации GPU-массивов,

- ограничений в межузловом взаимодействии.

Новая архитектура ПО ориентирована на централизованное управление вычислительными пулами, что позволяет:

- динамически перераспределять нагрузки,

- уменьшать простой ускорителей,

- повышать плотность вычислений на существующих серверах.

Унифицированное управление ускорителями

По данным источников, решение будет поддерживать:

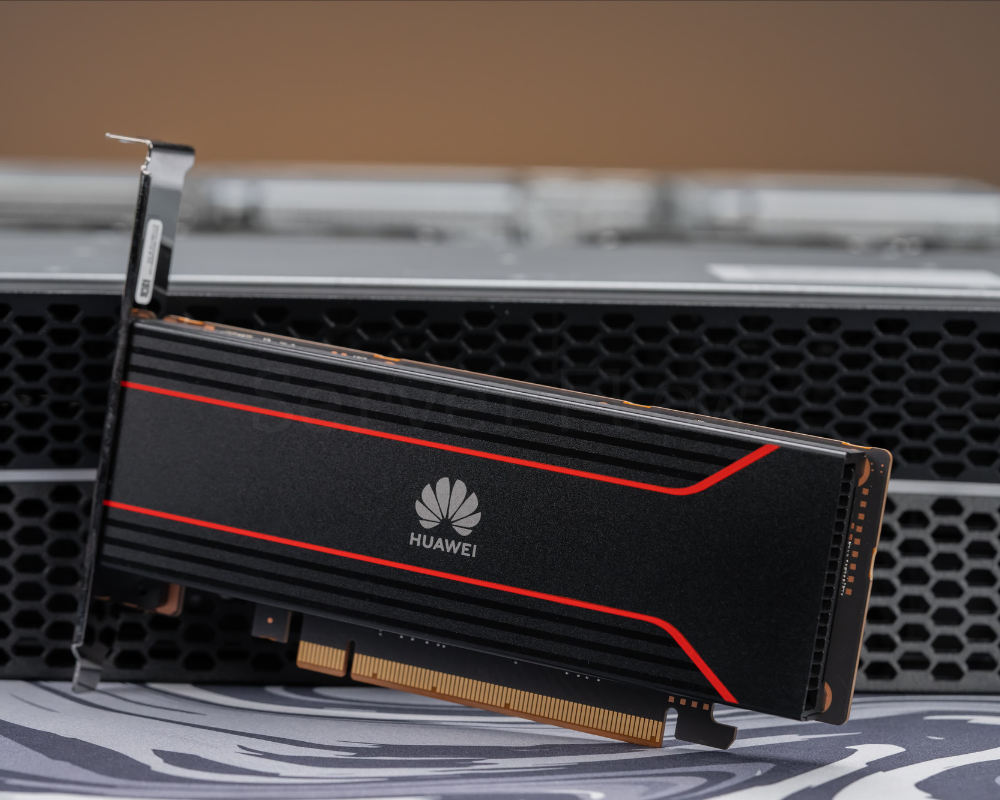

- ускорители Huawei Ascend,

- GPU NVIDIA,

- другие совместимые AI-чипы.

Это особенно важно для гибридных инфраструктур, где используются разные поколения ускорителей и отсутствует единый уровень управления.

Подход напоминает модель оркестрации, реализованную в решениях NVIDIA после приобретения Run:ai, однако Huawei делает акцент на независимой программной среде.

Экономический эффект для дата-центров

Повышение загрузки до 70% может означать:

- снижение потребности в закупке новых GPU,

- уменьшение CAPEX при масштабировании,

- повышение ROI существующих AI-кластеров,

- более предсказуемую модель роста инфраструктуры.

В условиях ограниченного доступа к передовым GPU это становится стратегическим преимуществом.

Связь с развитием Ascend и SuperPOD

Разработка логично дополняет планы Huawei по развитию линейки Ascend и созданию масштабных AI-кластеров (SuperPOD-архитектур). Программная оптимизация позволяет раскрыть потенциал аппаратных решений и повысить конкурентоспособность экосистемы Ascend.

Для проектов, где используются системы хранения данных Huawei OceanStor, подобный рост вычислительной плотности также означает увеличение требований к:

- пропускной способности,

- latency,

- параллельному доступу к данным,

- отказоустойчивости хранения.

Что это значит для клиентов OceanStor.ru

Для заказчиков, строящих AI-платформы на базе решений Huawei, ключевым становится комплексный подход:

- ускорители + серверная платформа,

- программная оркестрация,

- высокопроизводительная СХД,

- масштабируемая сеть.

Рост эффективности вычислений неизбежно повышает требования к системам хранения, что усиливает роль решений Huawei OceanStor в AI-архитектурах нового поколения.

Вывод

Huawei делает ставку на программную оптимизацию как инструмент усиления аппаратной экосистемы. Если заявленные показатели подтвердятся, компания сможет существенно повысить конкурентоспособность Ascend-платформ и предложить рынку более экономичную модель масштабирования ИИ-кластеров.

эффективность использования ИИ-ускорителей, программное обеспечение Huawei для ИИ, оптимизация загрузки GPU, оркестрация GPU и NPU, оптимизация AI-кластеров, управление ресурсами ИИ-кластера, оптимизация ИИ-инфраструктуры ЦОД, платформа Huawei Ascend, повышение ROI AI-кластера, корпоративная ИИ-инфраструктура, AI-инфраструктура в Европе, оптимизация вычислительных ресурсов ИИ, управление гетерогенными GPU-кластерами, программная оркестрация ускорителей, производительность AI-дата-центра